Israel utiliza inteligencia artificial para seleccionar objetivos en la Franja de Gaza

El ejército israelí utilizó inteligencia artificial para ayudar a seleccionar objetivos de bombardeo en Gaza. Esto podría haber provocado un deterioro de la precisión de los ataques y la muerte de muchos civiles. Así se informó en +972 Magazine y Local Call.

El sistema, denominado Lavender, se desarrolló tras los atentados del 7 de octubre contra Hamás. En el punto álgido de su desarrollo, Lavanda alcanzó los 37.000 ejemplares. palestinos de Gaza como presuntos “militantes de Hamás” y “autorizó” sus asesinatos.

Las fuerzas armadas israelíes negaron la existencia de dicha lista de asesinatos. El portavoz dijo que la inteligencia artificial no se utilizaba para identificar a sospechosos de terrorismo, pero no negó la existencia del sistema Lavender, que el portavoz calificó de “simples herramientas para que los analistas las utilicen en el proceso de identificación de objetivos.” Los analistas “deben llevar a cabo revisiones independientes para verificar que los objetivos identificados cumplen las definiciones pertinentes del derecho internacional y las restricciones adicionales de las directrices de las FDI”, declaró el portavoz.

Sin embargo, agentes de los servicios de inteligencia israelíes declararon a +972 y Local Call que no estaban obligados a llevar a cabo una verificación independiente de los objetivos de Lavender antes de bombardearlos y que, en su lugar, servían de “sello de goma” para las “decisiones de la máquina”. En algunos casos, el único papel de los agentes en el proceso era determinar si el objetivo era varón.

Para crear el sistema Lavender, se introdujo en el conjunto de datos información sobre operativos conocidos de Hamás y la Yihad Islámica Palestina. Además, la formación de Lavender también utilizó datos sobre personas estrechamente relacionadas con Hamás, como miembros del Ministerio de Seguridad Interna de Gaza.

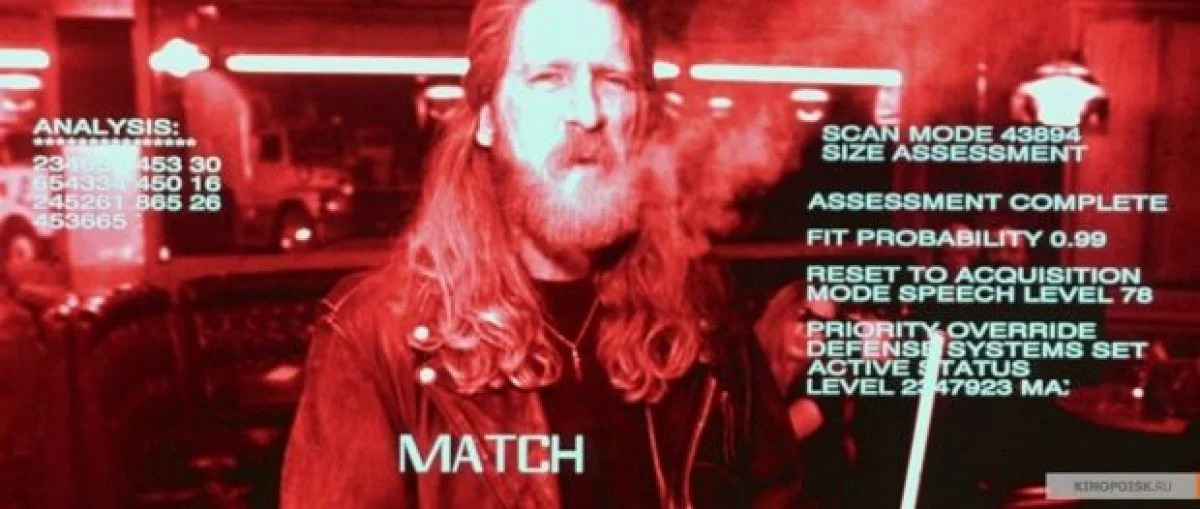

Lavender fue entrenado para identificar “características” asociadas a los operativos de Hamás, como estar en un grupo de WhatsApp con un militante conocido, cambiar de teléfono móvil cada pocos meses o cambiar de dirección con frecuencia. Estos datos se utilizaron después para calificar a otros palestinos de Gaza en una escala del 1 al 100 en función de su parecido con los combatientes de Hamás conocidos del conjunto de datos original. Las personas que alcanzaban un determinado umbral eran marcadas como objetivos de ataques. Este umbral ha estado cambiando constantemente, “porque depende de dónde se ponga el listón para saber quién es un operativo de Hamás”, dijo una fuente militar.

Según las fuentes, el sistema tenía un índice de precisión del 90%. Algunas de las personas que Lavender identificó como objetivos tenían nombres o apodos idénticos a los de conocidos operativos de Hamás. Otros eran familiares de operativos de Hamás o personas que utilizaban teléfonos que habían pertenecido a combatientes de Hamás.

Según fuentes bien informadas, los agentes de inteligencia disponían de amplios poderes cuando se trataba de víctimas civiles. Se asumió que habría daños colaterales entre los civiles: entre 15 y 20 personas en el caso de los operativos de bajo nivel de Hamás y “cientos” en el caso de los altos cargos de Hamás.

Los presuntos militantes de Hamás también fueron objeto de ataques en sus domicilios, según determinó el sistema ¿Dónde está papá? Según los agentes, el sistema ponía bajo vigilancia constante a los objetivos identificados por Lavender. Se les seguía la pista hasta que llegaban a sus casas, momento en el que eran bombardeados, a menudo con toda su familia. Sin embargo, a veces los agentes bombardeaban las casas sin comprobar si había objetivos en su interior, matando a civiles en el proceso.

Además, según los informes, el sistema Lavender es una ampliación del uso que Israel hace de las tecnologías de vigilancia contra los palestinos tanto en la Franja de Gaza como en Cisjordania.